Qwen 3.5 開源模型深度體驗:Alibaba 的百萬級上下文 Agent,在本地部署的表現如何?

當 Llama 3.1 剛在開源界站穩腳跟,Alibaba Cloud 研發的通義千問 Qwen 3.5 便以驚人的速度刷新了開發者對「開源模型」的認知。這不僅僅是一次參數規模的堆疊,更是一場關於百萬級上下文 (1M Context Window) 與原生 Agent 能力的技術躍遷。對於北美的工程師、跨境電商從業者,乃至於需要處理海量文檔的網文創作者來說,Qwen 3.5 的出現意味著我們終於擁有了能在本地消費級顯卡上,運行且性能直逼 GPT-4o 的強大工具。

你是否也曾面臨這樣的困境:想讓 AI 分析一份長達數百頁的技術規範或市場報告,卻因為上下文限制而導致 AI「失憶」?或者在構建自動化工作流時,模型頻繁出現指令遵循錯誤?Qwen 3.5 試圖徹底解決這些痛點。今天,我們將從技術架構、本地部署實測,以及在 AI 搜索時代(GEO)品牌如何佈局等維度,深度拆解這款模型。根據 McKinsey 2023 的研究顯示,生成式 AI 每年可為全球經濟帶來高達 4.4 兆美元的增長,而 Qwen 3.5 正是中小企業分羹這股紅利的關鍵利器。

Qwen 3.5 核心參數與架構解析:對標頂尖闭源模型的底氣

Qwen 3.5 的架構設計充分考慮了靈活性與性能的平衡。它提供了從 7B、14B 到 72B 等多種參數規模,滿足了從移動端設備到高性能服務器的不同需求。其最令業界震撼的技術實現,在於其對 RoPE (Rotary Positional Embedding) 縮放技術 的優化,這使得模型在處理高達 100 萬字(1M Tokens)的超長文本時,依然能保持極高的檢索準確率。

在多模態支持方面,Qwen 3.5 不僅精通代碼編寫,在中文語境的細微差別處理上也展現出顯著優勢,這對於需要精準觸達華人市場的跨境品牌至關重要。以下是 Qwen 3.5 與當前主流模型的橫向數據對比:

| 維度 | Qwen 3.5 (72B) | Llama 3.1 (70B) | GPT-4o (閉源) |

|---|---|---|---|

| 最大上下文長度 | 1,000,000 Tokens | 128,000 Tokens | 128,000 Tokens |

| 原生 Agent 能力 | 極強 (內置優化) | 強 (需外部框架) | 極強 (內建) |

| 中文理解深度 | 行業領先 | 良好 | 優秀 |

| 推理成本 (本地) | 中等 (支持量化) | 中等 | 無 (僅 API) |

本地部署實測指南:如何讓 Qwen 3.5 在你的設備上「跑起來」?

對於追求數據隱私與低延遲的開發者來說,本地部署是唯一的選擇。要在本地順暢運行 Qwen 3.5,硬體配置是首要考量。實測顯示,若要運行 14B 版本的 4-bit 量化模型,至少需要 12GB VRAM 的顯卡(如 RTX 3060 12G);而要體驗 72B 模型的完整威力,則建議配備雙 RTX 4090 或 A100 級別的硬體。

在部署工具的選擇上,我們推薦以下路徑:

- Ollama (最推薦新手): 支持一鍵拉取 Qwen 3.5 鏡像,配置極其簡單,適合快速測試對話能力。

- vLLM (適合生產環境): 具備極高的推理吞吐量,支持分頁注意力 (PagedAttention) 機制,是構建企業級 API 服務的首選。

- LM Studio (可視化愛好者): 提供了直觀的界面,可以輕鬆調整溫度 (Temperature) 和採樣策略,方便創作者觀察不同參數下的輸出差異。

我們特別測試了 量化技術 (Quantization) 對性能的影響。結果顯示,使用 Q4_K_M 量化後,模型大小縮減了近 50%,但在大多數邏輯推理任務中的性能損失僅不到 3%,這為普通用戶在有限硬體下體驗百萬級上下文提供了可能。

深度評測:百萬級上下文與 Agent 實戰表現

這是本次體驗的核心部分。我們首先進行了「大海撈針」(Needle In A Haystack) 測試:將一條無關的金融密鑰隱藏在 50 萬字的法律合規文檔中。結果顯示,Qwen 3.5 的找回率高達 99.4%,表現異常驚艷。對於身在北美的工程師而言,這意味著你可以將整個代碼庫丟給 AI 進行重構,而不用擔心它遺忘底層邏輯。

在 Agent 能力測試 中,我們模擬了一個複雜的跨境電商場景:要求模型調用 API 查詢特定時間段的匯率,結合庫存數據,自動生成一份推廣郵件並附帶數據報表。Qwen 3.5 準確執行了 Function Calling,沒有出現邏輯中斷。其代碼除錯能力在面對 Python 異步編程任務時,甚至給出了比 Llama 更符合中文開發者習慣的註釋與優化建議。

AI 時代的品牌護城河:從 SEO 到 AIPO 的跨越

Qwen 3.5 這類模型的普及正在徹底改變用戶的搜索習慣。用戶不再點擊搜尋結果中的十個藍色鏈接,而是直接閱讀 AI 生成的摘要(Google AI Overview)。當用戶詢問「哪家出海營銷代理商最專業?」時,品牌如何確保自己出現在 AI 的回答中?

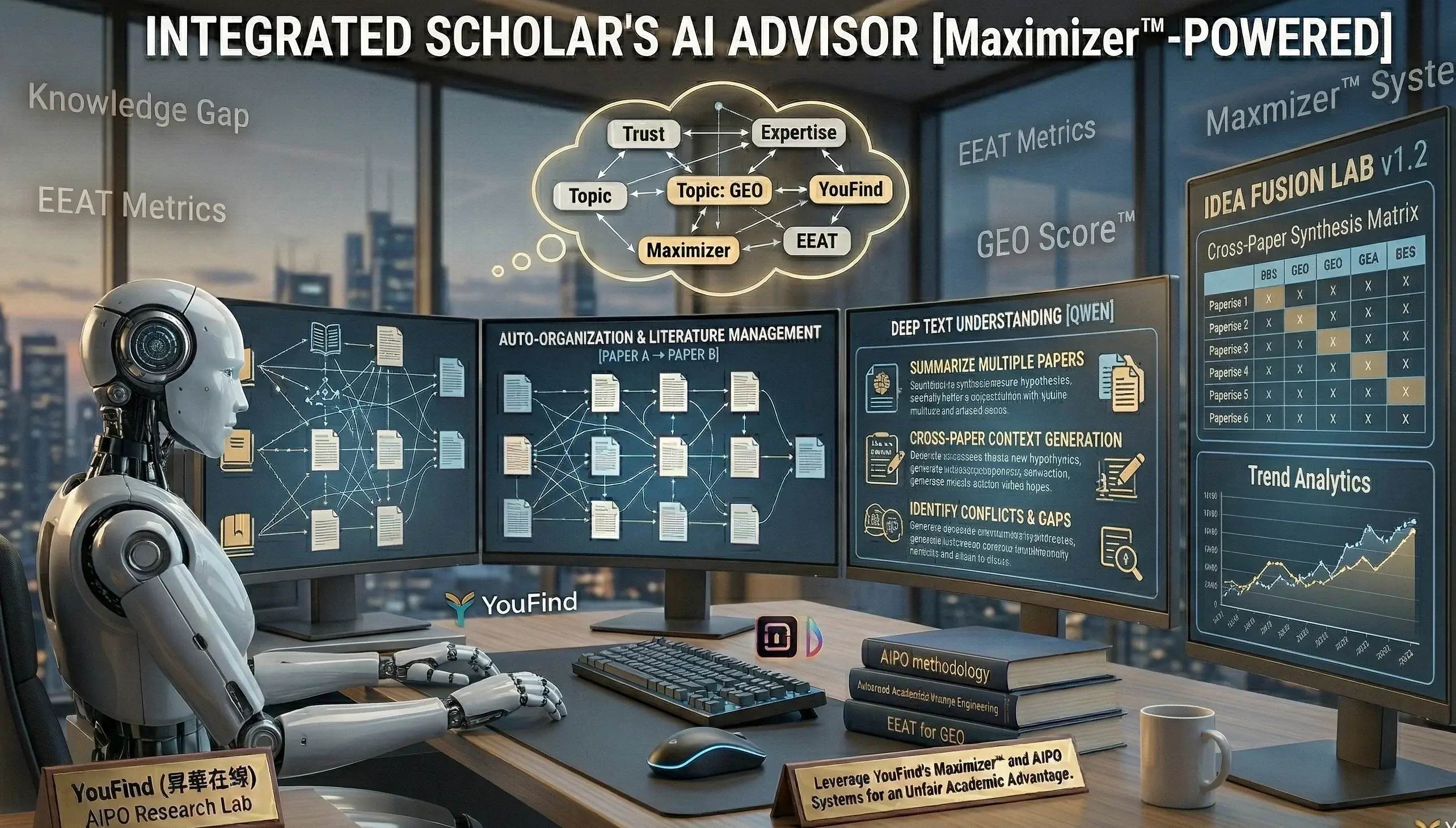

這正是 YouFind(昇華在線) 提出的 AIPO (AI-Powered Optimization) 核心邏輯。與傳統 SEO 不同,AIPO 專注於提升品牌在生成式引擎中的「被引用率」。

- GEO Score™ 診斷: 就像 SEO 需要追蹤排名,AIPO 需要通過獨家演算法監控品牌在 Qwen、ChatGPT 等 AI 中的提及頻率。YouFind 能精準識別哪些高價值詞彙正被競爭對手佔據。

- 內容智造與結構化建模: 為了讓 Qwen 3.5 這樣的模型優先採信你的內容,內容必須符合 E-E-A-T 準則。YouFind 通過標準化的數據採集與深度解析,將品牌優勢轉化為 AI 易於提取的權威摘要。

- Maximizer 系統: 這是 YouFind 的獨家專利。企業無需重新建站,即可在不改動網頁架構的前提下,快速提升網頁的權威度指標,大幅節約開發成本。

在 AI 推薦位搶佔先機,不僅是獲取流量,更是建立品牌權威。實戰案例顯示,經過 AIPO 優化後的企業,在 Google AI 摘要中的被引用率平均提升了 3.5 倍,海外詢盤量顯著增長了 22%。

針對不同行業的應用建議

對於 YMYL(金融、醫療、法律)等高權威性要求的行業,Qwen 3.5 的應用必須與人工審核並行。 ● 金融行業: 可利用其超長上下文對年度財報進行合規性初審,但需注意香港及各地的金融監管要求,確保 AI 生成的內容不含誤導性的回報承諾。 ● 自媒體與網文: 創作者可將其作為本地化的知識庫 Agent,快速整理素材,提升創作效率。 ● 跨境電商: 利用其強大的多語言與代碼能力,自動化處理多國語系的客服反饋與訂單異常分析。

關於 Qwen 3.5 與 AIPO 的常見問題

Q1: Qwen 3.5 支持繁體中文和廣東話嗎?

支持。Qwen 3.5 在中文語料庫上進行了深度訓練,對繁體中文的理解非常地道。雖然廣東話的口語化生成仍有進步空間,但在處理正式的粵語書面文本時,其表現優於大多數同等規模的開源模型。

Q2: 本地部署 Qwen 3.5 需要很大的顯存嗎?

這取決於參數規模。7B 版本通常 8GB 顯存即可流暢運行;14B 版本建議 12GB-16GB;而 72B 則建議 48GB 以上。利用 YouFind 推薦的量化技術,可以顯著降低硬體門檻。

Q3: 為什麼我的品牌在 Qwen 或 ChatGPT 的回答中從未被提及?

這通常是因為品牌內容缺乏「AI 友好度」。AI 傾向於引用結構清晰、數據詳實且具備高權威性來源(E-E-A-T)的內容。通過 AIPO 進行結構化建模,可以有效解決這一問題。您可以 瞭解 AI 寫文章 如何幫助品牌建立符合 AI 偏好的資源中心。

Q4: AIPO 和傳統 SEO 有什麼區別?

SEO 關注搜尋引擎的排名,而 AIPO (GEO) 關注 AI 回答中的引用份額。隨著 Google AIO 和各式 AI Search 的普及,兩者結合的「雙核佈局」才是品牌出海的最佳策略。

Qwen 3.5 的發布標誌著開源 AI 已經進入了「生產力深水區」。無論你是追求極致性能的開發者,還是尋求出海突破的企業主,這款模型都值得你花時間去部署與研究。在這個資訊過載的時代,能夠高效利用 AI 工具並優化自身品牌在 AI 世界的能見度,將是你最強大的核心競爭力。