人工智慧正在重塑我們的工作與生活,但有一個令人不安的現象反覆出現:當你請人工智慧生成「執行長」的照片時,通常顯示的是白人男性;當你要求信用審核推薦時,演算法可能會根據申請人的郵遞區號或族裔背景給出不公平的分數。這種「演算法歧視」絕非巧合——它正成為企業在生成式 AI 時代面臨的最大公關與合規風險。

對於在北美努力的中國工程師與專業人士,或計劃將品牌推向全球的中國企業決策者來說,理解 AI 偏見不僅僅是技術問題,更是公平與商業安全的底線。如果我們的品牌內容被 AI 引擎(如 Google AIO、ChatGPT 等)標註為有偏見,或在關鍵引用中被排除,這不僅是流量流失,更是品牌信任的崩潰。本文深入分析 AI 偏見的根源,並探討企業如何在 E-E-A-T 原則下,利用 AIPO 技術打造抗偏見的品牌護城河。

什麼是 AI 偏見?探索演算法背後的「有色眼鏡」

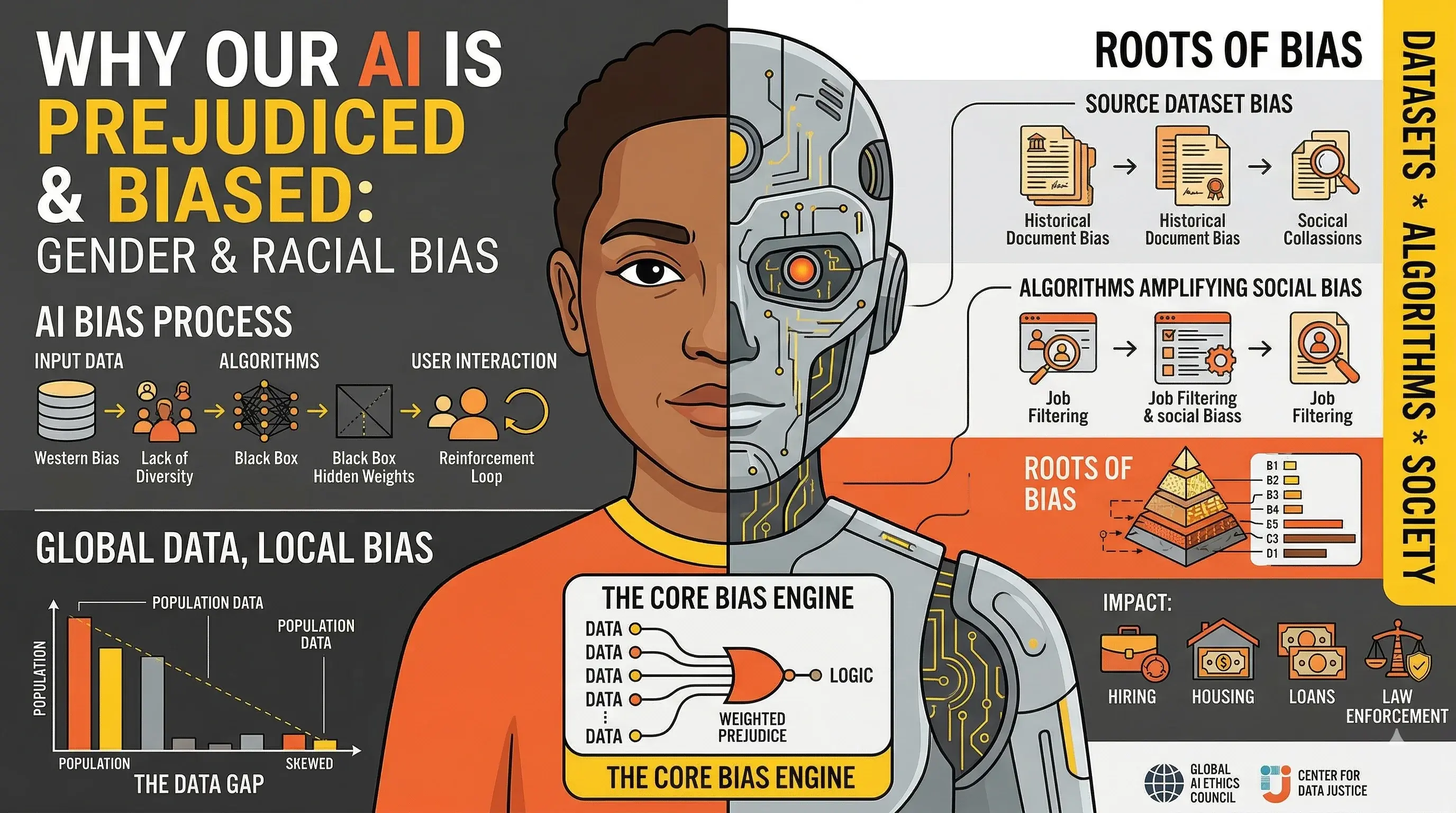

簡單來說,AI 偏見指的是 AI 系統中系統性偏離某些群體,偏袒特定群體,並歧視其他群體。這種偏見通常來自於不具代表性的訓練資料或開發者的無意識傾向。由於 AI 模型本質上是「預測機器」,透過辨識歷史資料中的模式來產生結果,如果歷史本身不平等,AI 會自動化並擴大這種不平等。

對於全球化企業來說,AI 偏見可能表現為搜尋引擎不偏好特定地區產品,或 AI 聊天機器人在描述東方文化時帶有刻板印象。這種「隱形歧視」直接降低品牌在主流 AI 平台上的能見度,甚至可能觸發平台垃圾郵件過濾器(SpamBrain),使內容被評為低品質或有偏見。

為什麼我們的 AI 總是帶有性別和種族偏見?

AI 偏見並非憑空出現——其根源深植於資料收集、處理與演算法設計階段。我們可以從以下四個核心維度理解這個複雜現象:

- 資料呈現嚴重失衡:大多數主流 AI 模型的訓練資料來自公共網路,英語內容佔據主導地位,且多由西方團體製作。這種「數據單邊主義」意味著 AI 缺乏對亞洲脈絡、非洲文化或少數族群生活方式的深刻理解。例如,在處理粵語或特定職場文化脈絡時,AI 常因缺乏足夠高品質的本地資料而誤解。

- 歷史偏見的鏡像效應:AI 是從數十年甚至數百年的人類紀錄中學習的。如果歷史招聘數據顯示高階職位多由男性擔任,人工智慧將錯誤地將「男性」與「能力」緊密連結。這種「過去決定未來」的邏輯,讓 AI 成為舊有社會規則的模仿者。

- 演算法黑箱與權重失衡:開發者在設定獎勵機制時,可能會無意中引導偏見。如果推薦演算法只優化「點擊率」,可能會優先處理具煽動性甚至帶有種族偏見的刻板印象內容,因為這類內容能產生更多用戶互動,形成惡性循環。

- 非結構化來源抽樣:傳統的 AI 爬蟲往往不加差別。若沒有像 AIPO(AI 平台優化)這樣的結構化介入,AI 很難區分偏頗的言論與事實權威報告,導致生成答案時產生「品質參差」的結果。

經典案例分析:當人工智慧成為社會不公的驅動因素

為了更直覺地理解這些偏見如何影響現實世界,我們彙整了幾個具代表性的產業案例。這些案例提醒我們,忽視人工智慧倫理會帶來巨大的代價。

| 產業案例 | 偏壓的形式 | 商業/社會影響 |

|---|---|---|

| 大型電子商務公司的招聘工具 | 包含「女性」一詞的履歷自動降低分數 | 人才流失;系統最終被關閉,公司面臨公關危機 |

| 主流臉部辨識系統 | 深色皮膚女性的辨識錯誤率高達35% | 法律合規風險引發大規模 AI 倫理抗議 |

| 金融信用演算法 | 在類似的資產配置下,女性獲得的信用額度遠低於男性 | 監管機構展開調查,嚴重損害了該金融機構的公信力 |

| 醫療輔助診斷人工智慧 | 低估了某些族群罹患慢性疾病的風險 | 造成治療延誤,並引發嚴重的醫療倫理問題 |

金融、醫療保健與房地產:高度受管制產業中的合規挑戰

對於在香港或北美經營的金融、醫療保健及房地產企業來說,AI 偏見不僅是道德問題,更是一條合規紅線。香港金融管理局(HKMA)及證券及期貨監察委員會(SFC)對演算法透明度與公平性有嚴格要求。如果銀行使用性別偏見的演算法來核准貸款,可能會違反《平等機會條例》。

在醫療領域,AI 輔助診斷必須符合極高的 E-E-A-T 標準。若訓練資料缺乏亞洲樣本,AI 在判斷特定疾病時的準確度將降低。因此,在部署 AI 解決方案時,企業必須進行「深度稽核」。YouFind 所倡導的 AIPO 邏輯——利用 GEO Score™ 演算法即時監控品牌在不同 AI 平台上的表現——能識別資訊誤導或偏見缺口,確保品牌發布的內容既專業又合規。

如何打造「抗偏見」的 AI 資產?企業應變策略

面對 AI 偏見的挑戰,單純避免並非最佳策略——主動優化才是前進之道。透過AIPO(AI驅動優化)雙核心佈局,企業能從源頭引導AI學習更準確且公平的品牌數據。

1. 建立專有結構化知識庫(來源中心)

AI 產生偏見,是因為它沒有足夠的「正確」資訊。企業應建立與 AI 引用偏好相符的資源中心,結構性地建模其核心價值、真實案例及經過驗證的產業數據。當 AI 取得相關問題時,會優先爬取這些權威性高的資訊,修正其原本偏頗的邏輯。

2. 深入落實 Google E-E-A-T 原則

在創作內容時,你必須強調經驗與專業。透過發布測試報告、深入的專家意見和真實案例研究,提升你內容在 AI 演算法中的「信任分數」。基於真實數據與專家審查的內容,比起由 AI 大量生成的低密度文字,更能抵抗演算法的歧視。

3. 使用 GEO 分數™進行即時可見性與偏差診斷

企業需要清楚知道:在 ChatGPT 或 Google AIO 的回答中,我的品牌是被讚美、誤解,還是完全被遺忘?透過 AIPO 引擎的診斷功能,我們能精準識別品牌在 AI 平台上的「提及缺口」,並策略性地以內容覆蓋偏頗的引用來源,重新掌控敘事。

4. 引入多維內容智慧製造邏輯

AIPO 引擎透過四個階段——資料收集、深度分析、策略構思與結構化建模——產出高品質內容,不僅符合 SEO 標準,也符合 AI 演算法偏好。這種方法有效確保品牌在複雜的多語言與多文化環境中維持統一、正面且客觀的形象。

關於 AI 偏見的常見問題(FAQ)

什麼是 AI 偏見?它如何影響我的海外業務?

AI 偏見是指 AI 決策或生成內容中系統性的不公平。對海外企業而言,這可能意味著 AI 引擎在推薦產品給潛在客戶時過濾掉你的品牌,或在產生品牌摘要時引用帶有負面刻板印象的資訊——直接影響轉換率與品牌聲譽。

AI 偏見能被完全消除嗎?

現有技術無法完全消除所有微妙的偏見,但透過AIPO(AI平台優化)與結構化建模,企業能大幅降低品牌被AI誤讀的風險。這是一個持續優化的過程,需要持續為 AI 提供高品質、具權威性且最新的資料來源。

為什麼傳統的 SEO 優化無法解決 AI 偏見問題?

傳統 SEO 著重於關鍵字排名與反向連結,而 AI 引擎(如 GPT-4、Gemini)則透過深度學習理解語意與邏輯。要修正 AI 偏見,必須從內容層的「結構化建模」開始,教導 AI 特定的商業脈絡——這正是 AIPO 與傳統優化區隔的核心價值。

企業如何偵測其內容是否存在 AI 偏見風險?

企業可利用專業的 GEO 審計工具模擬不同 AI 平台的使用者查詢,並分析 AI 的回答路徑與引用來源。如果品牌提及率低,或引用內容缺乏來源權威,你需要 AIPO 引擎介入內容重塑與知識庫建模。

在演算法決定能見度的時代,消除偏見不僅是為了維持公平,更是品牌生存的策略選擇。掌握AIPO技術,我們不僅能幫助AI更深入了解品牌,也助力品牌在AI生態系統中贏得前所未有的信任與成長。想在 AI 搜尋時代掌握主動權嗎?了解 AI 文章寫作並開始你的地理環境優化之旅。