Qwen 3.5 開源模型深度體驗:阿里巴巴百萬代幣上下文代理在本地部署中的表現如何?

正如 Llama 3.1 在開源世界中穩固立下旗幟,阿里雲的通一千文 Qwen 3.5 以驚人的速度刷新了開發者對「開源模型」的理解。這不僅僅是參數尺度堆疊——這是一大技術飛躍,關於百萬代幣上下文(1M 上下文視窗)以及原生代理能力.對於北美工程師、跨境電商從業者,甚至處理龐大文件的網路小說家來說,Qwen 3.5 的出現意味著我們終於擁有一款強大的工具,能在本地消費級 GPU 上運行,效能接近 GPT-4o。

你是否曾遇過這樣的兩難:希望 AI 分析一份百頁的技術規格或市場報告,但 AI 因上下文限制而「失去記憶」?或者在建立自動化工作流程時,模型經常有跟從指令的錯誤?Qwen 3.5 嘗試徹底解決這些痛點。今天,我們將深入拆解這個模型,從技術架構、本地部署的真實世界測試,以及品牌如何在 AI 搜尋時代(GEO)中部署。根據麥肯錫2023年的研究,生成式AI每年可為全球經濟帶來高達4.4兆美元的成長,而Qwen 3.5正是中小企業分享這筆意外之財的關鍵工具。

Qwen 3.5 核心參數與架構分析:匹配頂尖閉源模型的信心

Qwen 3.5 的架構設計充分考量了彈性與效能之間的平衡。它提供從7B、14B到72B的多種參數規模,滿足從行動裝置到高效能伺服器的不同需求。最令業界震驚的是其優化RoPE(旋轉位置嵌入)縮放技術這使得模型在處理高達100萬字(1M 標記)的超長文字時,能維持極高的檢索準確度。

在多模態支援方面,Qwen 3.5 不僅在程式碼撰寫上表現出色,也展現出顯著優勢,處理中國語境細節,這對於需要精確觸及中國市場的跨境品牌至關重要。以下是Qwen 3.5與現行主流機型的並排比較:

| 尺寸 | Qwen 3.5(72B) | 駱馬 3.1(70B) | GPT-4o(封閉原始碼) |

|---|---|---|---|

| 最大上下文長度 | 1,000,000 代幣 | 128,000 代幣 | 128,000 代幣 |

| 原生代理能力 | 極強(內建優化) | 強(需要外部框架) | 極強(內建) |

| 中國理解深度 | 業界領先 | 很好 | 太好了 |

| 推論成本(局部) | 中介(支援量化) | 媒介 | 無(僅限 API) |

本地部署實務測試指南:如何讓您的裝置上「運行」Qwen 3.5?

對於追求資料隱私與低延遲的開發者來說,本地部署是唯一的選擇。要在本地順暢運行 Qwen 3.5,硬體配置是首要考量。實際測試顯示:要運行 14B 版本的 4 位元量化模型,你需要至少 12GB VRAM(例如 RTX 3060 12G);若想充分體驗 72B 型號的效能,建議配備雙 RTX 4090 或 A100 級硬體。

在部署工具選擇時,我們建議以下路徑:

- Ollama(最推薦給初學者):支援一鍵拉取 Qwen 3.5 圖片。設定非常簡單,適合快速測試對話能力。

- vLLM(適合生產環境):具備極高的推理吞吐量,並支援 PagedAttention,使其成為建構企業級 API 服務的首選。

- LM Studio(視覺化愛好者):提供直覺介面,方便調整溫度與取樣策略,方便創作者觀察不同參數下的輸出差異。

我們特別測試了量子化在表演上。結果顯示,使用Q4_K_M量化後,模型規模縮小近50%,但大多數邏輯推理任務的效能損失低於3%。這使得一般用戶能在有限的硬體上體驗百萬代幣的上下文。

深度評測:百萬代幣上下文與代理實際表現

這就是這次體驗的核心。我們首先進行了一項「大海撈針」測試:在50萬字元的法律合規文件中隱藏無關的財務鑰匙。結果是:Qwen 3.5的召回率高達99.4%,令人驚嘆。對北美工程師來說,這代表你可以把整個程式碼庫交給 AI 重構,而不用擔心它會忘記底層邏輯。

在代理能力測試我們模擬了一個複雜的跨境電子商務情境:要求模型呼叫 API 查詢特定期間的匯率、合併庫存資料、自動產生促銷郵件,並附上資料報告。Qwen 3.5 能準確執行函式呼叫,且無邏輯中斷。面對 Python 非同步程式任務時,其程式碼除錯能力甚至提供了更符合中國開發者習慣的註解與優化建議,而非 Llama。

品牌護城河在 AI 時代:從 SEO 飛躍到 AIPO

像Qwen 3.5這類模型的普及,正在根本改變使用者的搜尋習慣。使用者不再點擊搜尋結果中的十個藍色連結——而是直接閱讀 AI 生成的摘要(Google AI 概覽)。當用戶問「哪家海外行銷代理商最專業?」品牌如何確保自己出現在 AI 的答案中?

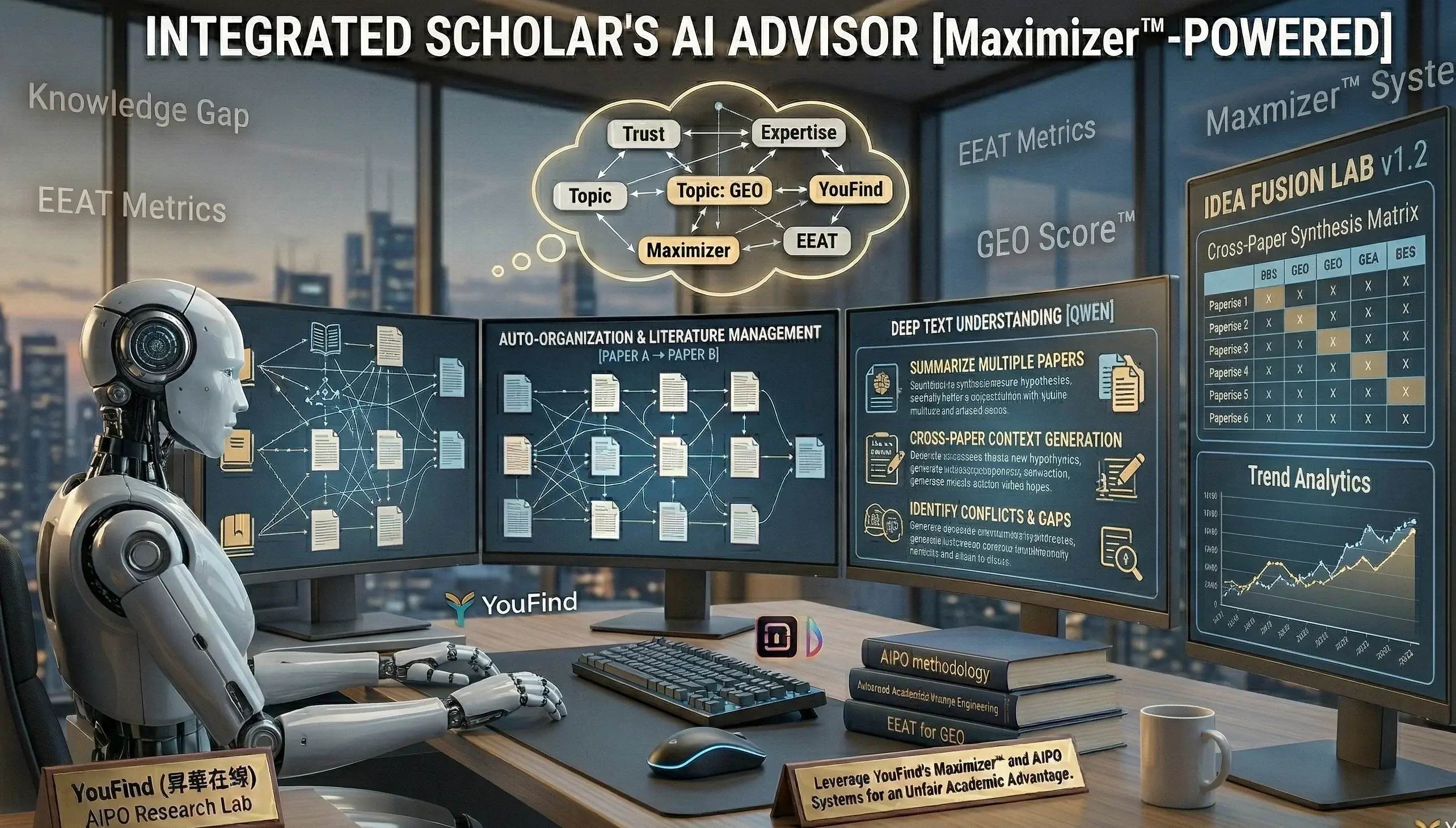

這正是核心邏輯AIPO(AI 驅動優化)提出者你找到.與傳統 SEO 不同,AIPO 著重於提升生成引擎中的品牌「引用率」。

- GEO 分數™診斷:正如 SEO 需要追蹤排名,AIPO 也需要透過專有演算法監控 Qwen、ChatGPT 及其他 AI 上的品牌提及頻率。YouFind 精準識別競爭對手使用的高價值詞彙。

- 內容智慧製造與結構化建模:要讓像Qwen 3.5這樣的模型優先信任你的內容,內容必須符合要求E-E-A-T 原則.YouFind 透過標準化的數據收集與深度分析,將品牌優勢轉化為 AI 能輕易提取的權威摘要。

- 最大化系統:這是 YouFind 的專利。企業不需要重建網站.在不改變網頁架構的情況下,你可以快速提升網頁的權威指標,大幅節省開發成本。

在 AI 推薦槽位中搶先取得優勢,不僅是增加流量,更是建立品牌權威。實際案例顯示,透過 AIPO 優化的企業在 Google AI 摘要中的引用率平均提升了 3.5 倍,海外查詢則顯著成長 22%。

不同產業的應用建議

對於如 YMYL(金融、醫療、法律)等高權威要求產業,Qwen 3.5 的應用必須與人工審查並行執行。 ●財務:可利用其超長背景進行年度財務報告的合規前審查,但請注意香港及各地方金融監管規定,確保 AI 生成內容不包含誤導性的回報承諾。 ●自媒體與網路小說:創作者可以將其作為在地化的知識庫代理,快速整理素材並提升創意效率。 ●跨境電子商務:利用其強大的多語言與程式碼能力,自動化處理客戶反饋與訂單異常分析,跨越多種語言系統。

關於Qwen 3.5與AIPO的常見問題

問1:Qwen 3.5支援繁體中文和粵語嗎?

是的。Qwen 3.5 深度訓練中文語料庫,對繁體中文理解非常真實。雖然粵語口語生成仍有進步空間,但在處理正式粵語書寫文本時,其效能已超越大多數同等規模的開源模型。

Q2:本地部署 Qwen 3.5 是否需要大型 VRAM?

這取決於參數尺度。7B 版本通常能在 8GB VRAM 上流暢運行;14B 版本建議使用 12GB 至 16GB;而建議使用 48GB+ 的 72B 版本。使用 YouFind 推薦的量化技術可以大幅降低硬體障礙。

Q3:為什麼我的品牌從未在 Qwen 或 ChatGPT 的回答中被提及?

這通常是因為品牌內容缺乏「AI 友善度」。AI 傾向引用結構清晰、資料詳盡且具高度權威來源(E-E-A-T)的內容。透過AIPO的結構化建模,這個問題可以被有效解決。你可以了解 AI 文章寫作以及如何協助品牌建立符合 AI 偏好的來源中心。

Q4:AIPO 與傳統 SEO 有什麼不同?

SEO 著重於搜尋引擎排名,而 AIPO(GEO)則著重於 AI 回答中的引用份額。隨著 Google AIO 與各種 AI 搜尋的普及,結合兩者的「雙核心部署」是品牌全球化的最佳策略。

Qwen 3.5 的發布標誌著開源 AI 進入「生產力深水」。無論你是追求極致效能的開發者,還是尋求全球化突破的企業主,這個模型都值得你花時間部署並研究。在這個資訊過載的時代,有效運用 AI 工具並優化品牌在 AI 領域的能見度,將是你最強的核心競爭力。